想自己跑 LLM?搞懂模型參數與量化讓你不再選錯模型

前言

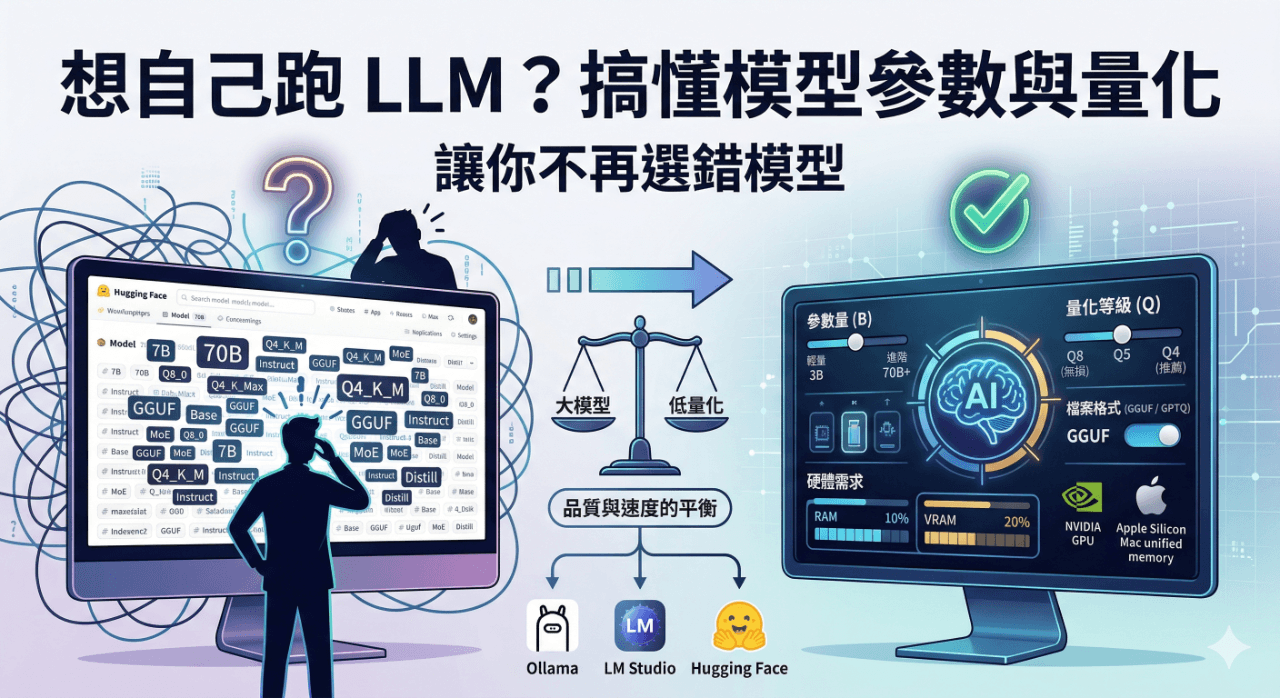

如果你有試過想把 AI 模型下載回自己的電腦跑,應該都會遇到一個問題:打開 Hugging Face 看到什麼 7B、Q4_K_M、GGUF 一堆看不懂的代號,根本不知道哪個才適合自己的電腦。這篇就來聊聊這些代號到底是什麼意思,以及該怎麼根據自己的硬體來挑模型。

Note

如果你還不知道怎麼在本地跑模型,可以先去看 架設自己的 AI 語言模型實驗室不求人之 LM Studio,裡面有從安裝到使用的完整教學。

模型後面的 B 是什麼意思?

你在瀏覽模型的時候,應該常常會看到模型名稱後面跟著一個數字加上 B,像是 4B、7B、70B 這樣。這個 B 就是 Billion(十億)的意思,代表這個模型有多少個參數(Parameters)。

那什麼是參數呢?簡單來講,參數就是模型在訓練過程中從大量資料裡面學到的數值。如果用比較生活面的例子來講的話,你可以把參數想像成一個人讀過的書,一個讀過幾千本書的人跟一個讀過幾萬本書的人,後者能回答的問題肯定比較多對吧?模型的參數量也是類似的概念,7B 就是 70 億個參數,70B 就是 700 億個參數,參數越多代表它學到的東西越多。

之前在 架設自己的 AI 語言模型實驗室不求人之 LM Studio 裡面有稍微提到過 B、M、T 這些代號,這篇會更深入地聊一下參數量跟實際使用之間的關係。

參數越大越好嗎?

你可能會想說:「那我直接挑參數最大的不就好了?」

可是事情沒有這麼簡單。參數量越大,它需要的硬體資源也越多,簡單來講就是你的電腦要夠力才跑得動。而且參數大不一定代表比較聰明,一個訓練得很好的 14B 模型,表現是有可能超過一個訓練品質普通的 70B 模型的,所以參數量只是其中一個參考指標。

那大概什麼等級的參數量適合什麼任務呢?這邊整理一下:

| 參數量 | 等級 | 適合的任務 |

|---|---|---|

| 1B - 3B | 輕量級 | 簡單對話、摘要、翻譯,手機 or 低階設備也能跑 |

| 4B - 9B | 入門級 | 寫程式輔助、問答、一般聊天,大多數人的起點 |

| 13B - 14B | 中階 | 推理能力明顯提升,能處理比較複雜的問題 |

| 27B - 32B | 進階 | 多步驟推理、專業領域問答 |

| 70B 以上 | 高階 | 接近雲端服務的品質,硬體門檻很高 |

從這張表可以看出來,對大多數人來講 4B - 9B 就已經很夠用了,不需要一開始就衝到 70B。

那我的電腦跑得動嗎?

知道參數量之後,接下來最實際的問題就是:到底要多少記憶體才夠?

這邊有一個很簡單的計算方式:在沒有壓縮的情況下,每 10 億個參數大約吃 2 GB 的記憶體。所以一個 7B 的模型就要 14 GB 左右,70B 的話就是 140 GB。

看到 140 GB 你可能已經開始冒冷汗了對吧?「我的電腦才 16 GB 記憶體,那不就只能跑最小的模型?」

先別急,這就是為什麼有量化這個技術的原因,後面會詳細聊。在那之前,我們先來看看模型名稱裡面還有哪些東西需要認識。

看懂模型名稱的每一個部分

假設你今天在 Hugging Face 上面看到這個模型:

1 | |

乍看之下好像很複雜,可是其實拆開來每一段都有它的意思:

| 部分 | 意義 |

|---|---|

| bartowski | 上傳者(這位是社群中很知名的量化貢獻者) |

| Meta | 模型的開發公司(Meta AI) |

| Llama | 模型家族名稱 |

| 3.1 | 版本號 |

| 8B | 80 億個參數 |

| Instruct | 經過指令微調,能聽懂你下的指令 |

| GGUF | 檔案格式(給本地跑模型用的) |

所以其實這串名稱就是在告訴你:這是一個由 bartowski 這個人幫忙轉檔的 Meta Llama 3.1 模型,8B 參數,經過指令微調,用 GGUF 格式存的。

Instruct、Base、Chat 這些標記是什麼?

在模型名稱裡面常常會看到一些標記,這些代表模型經過什麼樣的訓練。這邊挑幾個最常見的:

- Base:原始的模型,就像一個讀了很多書可是還沒學會怎麼跟人對話的學生,不太適合直接拿來聊天

- Instruct / IT:經過指令微調的版本,能聽懂你的指令然後給出對應的回覆。一般人要選這個

- Chat:針對多輪對話優化過的版本

- Coder:專門強化了寫程式的能力

- Distill:從大模型蒸餾出來的小版本,保留大部分能力可是體積更小

以我自己來講,如果你只是想在本地聊天 or 請 AI 幫忙處理一些日常問題,看到 Instruct 選它就對了。

Note

之前在 LM Studio 那篇有提到 Distill 跟 Instruct 的基本概念,有興趣的可以回去翻一下。

MoE 是什麼?看到 A22B 不要怕

最近越來越多模型會出現 MoE 這個標記,像是:

1 | |

看到 235B 你可能會想說:「2350 億個參數?我的電腦絕對跑不動吧?」

可是先等一下,注意後面還有一個 A22B。MoE 全名是 Mixture of Experts,什麼意思呢?簡單來講,這個模型裡面有很多個專家,可是每次回答問題的時候不會所有專家都出動,只會挑幾個相關的來處理。

所以 235B 是模型裡面所有專家加起來的總參數量(2350 億),而 A22B 是每次實際上只會啟用的參數量(Active 22B,也就是 220 億)。換句話說,雖然這個模型的知識量有 2350 億參數的水準,可是跑起來只需要 220 億參數等級的硬體資源。

這也是為什麼 MoE 現在越來越流行,它讓原本只有大公司才跑得動的巨型模型,一般人的電腦也有機會跑了。

Note

不過要注意的是,MoE 模型在硬碟空間上還是需要存下所有參數,所以檔案大小不會因為只啟用部分專家就變小。主要省的是跑起來時的記憶體跟運算量。

量化是什麼?讓你的電腦也跑得動大模型

前面有提到一個 7B 模型在沒壓縮的情況下就要 14 GB 記憶體,對一般人來說還是太大了。這時候就要靠量化(Quantization)來幫忙。

那量化是什麼呢?你可以想像成照片的畫質。一張 5000 萬畫素的照片雖然最清楚,可是檔案超大。如果你把它壓縮成 1200 萬畫素,放在手機上看其實幾乎看不出差異,可是檔案小了非常多。量化做的事情就跟這個很像,它把模型裡面每個參數的精度降低,讓檔案變小、記憶體用量也跟著變少。

Q4、Q8 這些數字是什麼?

你在下載模型的時候會看到 Q4_K_M、Q8_0 這些代號,前面的數字代表量化的精度,數字越小代表壓縮越多、檔案越小,可是品質也會有一些損失。

以一個 7B 模型來舉例的話:

| 量化等級 | 7B 模型大約大小 | 品質影響 |

|---|---|---|

| FP16(沒壓縮) | 約 14 GB | 沒有損失 |

| Q8_0(8-bit) | 約 7 GB | 幾乎感覺不到 |

| Q5_K_M(5-bit) | 約 4.8 GB | 非常輕微 |

| Q4_K_M(4-bit) | 約 3.8 GB | 輕微影響,大多數人的選擇 |

| Q3_K_M(3-bit) | 約 3 GB | 開始有明顯差異 |

| Q2_K(2-bit) | 約 2.5 GB | 明顯劣化,不推薦 |

從表格可以看到,同樣一個 7B 模型,從原本的 14 GB 壓縮到 Q4_K_M 之後只需要 3.8 GB 左右,這樣 8 GB 記憶體的電腦也跑得動了。而且 Q4 等級的品質損失其實滿小的,一般聊天幾乎感覺不出差異。

那 K_S、K_M、K_L 又是什麼?

量化代號後面常常還會接 K_S、K_M、K_L 這些後綴,這代表壓縮策略的不同:

- K_L(Large):保留最多細節,檔案最大

- K_M(Medium):平衡取向,最常被推薦的版本

- K_S(Small):壓縮最多,檔案最小,速度最快

這邊的 K 是指 K-Quants,它是一種比較聰明的壓縮方式。它不是一刀切把所有東西都壓到同樣的精度,而是會去判斷哪些參數比較重要就保留高一點的精度,不那麼重要的才壓低,所以整體品質會比單純壓縮好很多。

以我自己來講,大多數情況下選 Q4_K_M 就是一個很好的起點。

GGUF、GPTQ、AWQ 這些格式怎麼選?

除了量化等級之外,你還會看到不同的檔案格式,這邊介紹三個最常見的。

GGUF 是目前本地跑模型最主流的格式,Ollama、LM Studio、llama.cpp 都是用它。最大的好處是 CPU 跟 GPU 都能跑,不挑硬體。對一般人來說選 GGUF 就對了。

GPTQ 跟 AWQ 都是給 NVIDIA GPU 專用的格式,品質保留得不錯,可是一定要有 NVIDIA 顯卡才能用。如果你沒有 NVIDIA 顯卡,這兩個格式就不用考慮了。

所以如果你不確定該選什麼,記住一個組合就好:GGUF + Q4_K_M,這個適用於大多數人的情境。

根據硬體來挑模型

了解了前面這些概念之後,接下來就是最實際的問題:根據我手上的硬體,我該下載什麼模型?

8 GB 記憶體(沒有獨立顯卡)

這個等級能跑的模型有限,可是還是可以玩的。建議挑 3B - 4B 的模型搭配 Q4_K_M 量化,像是 Phi-4 Mini(3.8B)or Llama 3.2-3B,檔案大約 2 - 3 GB。簡單的聊天跟摘要沒問題,可是推論速度會比較慢。

16 GB 記憶體 or 8 GB VRAM 顯卡

這是目前大多數人的甜蜜點。可以跑 7B - 8B 的模型搭配 Q4_K_M,像是 Llama 3.1-8B or Qwen 2.5-7B,檔案大約 4 - 6 GB。寫程式輔助、問答、翻譯都表現不錯。

32 GB 記憶體 or 16 - 24 GB VRAM 顯卡

如果你有 RTX 4090(24 GB VRAM)or 32 GB 以上的記憶體,選擇就多很多了。30B 等級的模型可以用 Q5_K_M 甚至 Q6_K,70B 的話就需要壓到 Q4_K_M。品質已經接近雲端服務的水準了。

Apple Silicon Mac 使用者

如果你是用 Mac 的話,這邊有個好消息。Apple Silicon 有一個叫做統一記憶體(Unified Memory)的架構,簡單來講就是系統記憶體可以直接當 GPU 記憶體用,這在跑 LLM 上是一個非常大的優勢。

舉個例子,一台 36 GB 的 MacBook Pro 可以跑 30B 等級的模型(Q4 - Q8),而同價位的 Windows 筆電因為系統記憶體跟顯卡記憶體是分開的,純用 CPU 跑的速度會慢非常多。

| Mac 配置 | 記憶體 | 能跑的模型 |

|---|---|---|

| M 系列基本款 | 8 - 16 GB | 3B - 7B(Q4) |

| M 系列 Pro | 18 - 36 GB | 13B - 30B(Q4 - Q8) |

| M 系列 Max | 64 - 96 GB | 70B(Q4)or 30B(接近無損) |

| M 系列 Ultra | 128 GB 以上 | 100B 以上的 MoE 模型 |

一個很實用的選擇原則

這邊給一個通用的建議:

『與其挑一個大模型然後壓到很低的量化,不如挑一個小一點的模型用比較高的量化。』

什麼意思呢?假設你的電腦記憶體有限,一個 8B 的模型用 Q5_K_M 通常會比 13B 的模型硬壓到 Q3_K_M 表現更好。因為壓縮過頭反而會讓模型損失太多能力。

去哪裡下載模型?

知道怎麼挑之後,接下來就是要知道去哪裡下載了。

Hugging Face

你可以把它想像成 AI 模型界的 GitHub,是目前最大的模型集散地。上面除了原版模型之外,也有社群幫忙做好量化的版本。如果你在上面找 GGUF 格式的模型,可以認 bartowski or hugging-quants 這些帳號,他們的量化品質都滿穩定的。

Ollama

如果你不想搞太多有的沒的,Ollama 是最簡單的選擇。打開終端機輸入一行指令就能下載跟啟動模型:

1 | |

它會自動幫你下載模型、自動挑適合你硬體的量化版本,然後直接開始跟你聊天,完全不用自己去挑檔案。

LM Studio

如果你比較喜歡圖形介面的話,LM Studio 可以讓你在 App 裡面搜尋、下載、載入模型,完全不用碰命令列。

Note

如果你想看 LM Studio 的完整教學,可以參考 架設自己的 AI 語言模型實驗室不求人之 LM Studio。

2026 年有哪些熱門的開源模型?

最後這邊整理一下目前比較熱門的開源模型,讓你有個方向知道可以從哪個開始。

如果你是第一次嘗試,建議從 7B - 14B 這個範圍開始:

| 模型 | 開發者 | 參數量 | 特色 |

|---|---|---|---|

| Llama 3.1 8B | Meta | 8B | 泛用性很高,社群資源多 |

| Qwen 2.5 7B | Alibaba | 7B | 中文表現好,多語言支援 |

| Phi-4 | Microsoft | 14B | 推理能力超出同級,MIT 授權 |

| Gemma 3 9B | 9B | 支援多模態,表現均衡 |

如果你的硬體比較好,可以挑戰 27B - 70B 這個範圍:

| 模型 | 開發者 | 參數量 | 特色 |

|---|---|---|---|

| Gemma 4 27B | 27B(MoE,4B 啟用) | 速度快,記憶體需求低於同級 | |

| Qwen 2.5 32B | Alibaba | 32B | 品質很高,中文表現優秀 |

| Llama 3.3 70B | Meta | 70B | 需要較高硬體,品質接近雲端服務 |

| DeepSeek-R1 蒸餾版 | DeepSeek | 7B - 70B | 推理能力強,有各種大小的版本 |

然後前面提到的 MoE 架構,目前的代表有:

| 模型 | 開發者 | 總參數 / 啟用參數 | 特色 |

|---|---|---|---|

| Qwen3 235B-A22B | Alibaba | 235B / 22B | 知識量大,資源需求相對低 |

| DeepSeek-V3 | DeepSeek | 671B / 37B | 目前開源模型的天花板之一 |

| Llama 4 Scout | Meta | 109B / 17B | 支援超長 10M token 上下文 |

這個領域更新的速度非常快,幾乎每個月都有新的模型出來,所以這些推薦會隨時間變化。如果你想追最新的,可以關注 Hugging Face 的 Open LLM Leaderboard,上面會有各種模型的跑分排名。

總結

最後整理一下這篇的重點:

- 模型後面的 B 代表十億個參數,數字越大知識量越大,可是也越吃硬體資源

- 下載模型時選 Instruct 版本,Base 是給研究者用的

- 看到 MoE 跟 A 開頭的數字,代表實際啟用的參數量比總量小很多,更省資源

- 量化就是壓縮模型的技術,Q4_K_M 是大多數人的最佳起點

- 檔案格式選 GGUF 就對了,CPU 跟 GPU 都能跑

- 選模型的原則是讓模型完整塞進你的記憶體,不要硬塞大模型然後壓到極低的量化

- Mac 使用者因為統一記憶體的關係,在本地跑模型上有天生的優勢

希望這一篇有讓你對 LLM 模型的參數跟量化有更近一步的認識,之後在 Hugging Face 上面挑模型的時候就不會再霧煞煞了哩~